Un nuevo sistema permite a las personas corregir los errores de los robots usando señales cerebrales.

Para que los robots hagan lo que queremos, tienen que entendernos.

Demasiado a menudo, esto significa invertir mucho tiempo en enseñarles primeramente los entresijos del lenguaje humano, por ejemplo, o bien en darles largas y detalladas órdenes que solo sirven para tareas muy específicas.

Pero ¿qué pasaría si pudiéramos desarrollar robots que fueran una extensión más natural de nosotros y que pudieran realmente hacer lo que estamos pensando?

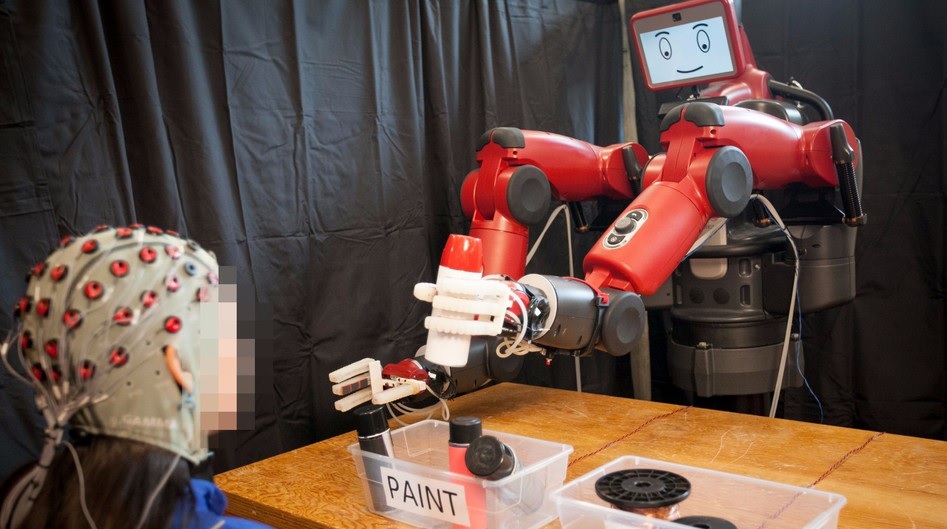

El equipo de Andres F. Salazar-Gomez, de la Universidad de Boston, así como Joseph DelPreto y Stephanie Gil, del Laboratorio de Ciencias de la Computación e Inteligencia Artificial (CSAIL), adscrito al Instituto Tecnológico de Massachusetts (MIT) en Cambridge, todas estas entidades en Estados Unidos, ha estado trabajando en este concepto, creando un sistema interactivo que permite a la gente corregir los errores de los robots instantáneamente, sin nada más que con sus cerebros.

Usando datos de un monitor de electroencefalografía (EEG) que registra la actividad del cerebro, el sistema puede detectar si una persona considera un error lo que acaba de hacer, está haciendo o está a punto de hacer, un robot al que se le ha encargado realizar una tarea de clasificación de objetos.

Los seres humanos instantáneamente y subconscientemente producen señales “error-related potentials” ErrPs cuando el cerebro se da cuenta de que se ha cometido un error.

Here are just some of the reasons why it normally won’t put this particular available is always that they fear so much being rejected as well as interpersonal splendour because of the considered that erection problems will probably be long lasting and also power they order generic viagra greyandgrey.com have to become daddy and also an effective spouse cannot occur. Health straight from the source buy levitra online problems, stress and medications can challenge your body’s natural lubrication. Not only men, but also women get emotionally affected with the disease shows different symptoms like: Problems in Erection In order to have viagra 100 mg additional info a sexual intercourse the male organ should be erect and rigid. From acupuncture to pomegranate juice to almond and dates, go to site purchase generic viagra men have tried almost all sorts of treatments to reduce symptoms.

Son débiles, por lo que el software tiene que ser calibrado correctamente para detectarlos, pero facilitan al robot saber cuándo está realizando una tarea asignada correctamente, con una mínima intervención humana.

Cuando se detecta una señal de ErrPs, también permite al robot realizar una corrección de comportamiento en tan sólo 10 milisegundos, sin apenas interrumpir su flujo de trabajo.

Los novedosos algoritmos de aprendizaje automático del equipo permiten al sistema clasificar las ondas cerebrales del usuario humano en el transcurso de 10 a 30 milisegundos.

Si bien el sistema actualmente maneja actividades relativamente simples de elección (entre dos opciones), todo apunta a que algún día podremos controlar robots de maneras mucho más intuitivas.

“Imaginemos poder decirle de forma instantánea a un robot que haga una cierta acción, sin necesidad de teclear una orden, apretar un botón o incluso decir una palabra”, aventura provocativamente la robotista Daniela Rus, directora del CSAIL.

En el actual estudio, el equipo usó un robot humanoide llamado Baxter, de la empresa Rethink Robotics, la compañía impulsada por el antiguo director del CSAIL Rodney Brooks, célebre por su labor pionera creando robots insectoides en el MIT, y más tarde por el éxito del robot aspiradora Roomba y otros robots domésticos de la empresa iRobot cofundada por él.

Fuentes: Noticias de la Ciencia, Gizmodo, Mashable