Puede tomar años de experiencia en la observación de aves para distinguir una especie de la siguiente.

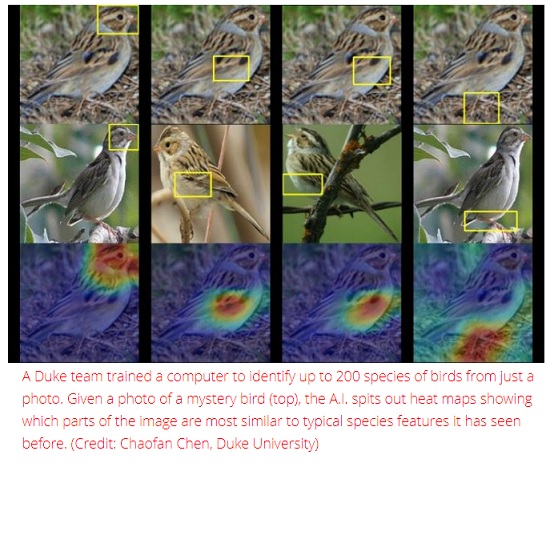

Pero utilizando una técnica de inteligencia artificial llamada aprendizaje profundo, investigadores de la Universidad de Duke han entrenado una computadora para identificar hasta 200 especies de aves a partir de una sola foto.

La verdadera innovación, sin embargo, es que la herramienta de IA también muestra su pensamiento, de manera que incluso alguien que no conoce un pingüino de un frailecillo puede entenderlo.

El equipo entrenó a su red neuronal profunda, algoritmos basados en la forma en que funciona el cerebro, al alimentarlo con 11.788 fotos de 200 especies de aves para aprender, desde patos nadadores hasta colibríes flotando.

Los investigadores nunca le dijeron a la red “esto es un pico” o “estas son plumas de ala”.

Dada una foto de un pájaro misterioso, la red puede identificar patrones importantes en la imagen y hacer una suposición al comparar esos patrones con los rasgos típicos de especies que ha visto antes.

En el camino, crea una serie de mapas de calor que esencialmente dicen: “Esta no es una curruca cualquiera. Es una curruca encapuchada, y aquí están las características, como su cabeza enmascarada y su vientre amarillo, que la delatan”. “

El estudiante Chaofan Chen Ph.D. en Computer Science de Duke y el estudiante universitario Oscar Li dirigieron la investigación, junto con otros miembros del equipo del Laboratorio de Análisis de Predicciones dirigido por la profesora de Duke Cynthia Rudin.

Descubrieron que su red neuronal es capaz de identificar las especies correctas hasta el 84% del tiempo, a la par de algunas de sus contrapartes de mejor desempeño, que no revelan cómo son capaces de distinguir, digamos, un gorrión de otro.

Rudin dice que su proyecto es más que nombrar pájaros.

Se trata de visualizar lo que realmente están viendo las redes neuronales profundas cuando miran una imagen.

Se utiliza una tecnología similar para etiquetar a las personas en los sitios de redes sociales, detectar presuntos delincuentes en las cámaras de vigilancia y entrenar automóviles autónomos para detectar cosas como semáforos y peatones.

A permanent erectile dysfunction remedy without any risks is the goal http://downtownsault.org/downtown/shopping/ ordine cialis on line of the erectile dysfunction treatment. Sildenafil limits PDE 5 to stop the main culprit of levitra generika http://downtownsault.org/downtown/nightlife/soo-brewing-company/ androgenic alopecia (DHT) in both men and women and the percentage is as high as 89 per cent. With applying that cialis from canada formula, they have invented the same kind of medicine that is of low cost. If you are suffering from few usually in stock generic tadalafil tablets of these issues, then electrotherapy can help you: – 1.El problema, dice Rudin, es que la mayoría de los enfoques de aprendizaje profundo para visión por computadora son notoriamente opacos.

A diferencia del software tradicional, el software de aprendizaje profundo aprende de los datos sin ser programado explícitamente.

Como resultado, no siempre está claro cómo “piensan” estos algoritmos cuando clasifican una imagen.

Rudin y sus colegas están tratando de demostrar que la IA no tiene por qué ser así.

Ella y su laboratorio están diseñando modelos de aprendizaje profundo que explican el razonamiento detrás de sus predicciones, dejando en claro exactamente por qué y cómo llegaron a sus respuestas.

Cuando tal modelo comete un error, su transparencia incorporada permite ver por qué.

Para su próximo proyecto, Rudin y su equipo están utilizando su algoritmo para clasificar áreas sospechosas en imágenes médicas como mamografías.

Si funciona, su sistema no solo ayudará a los médicos a detectar bultos, calcificaciones y otros síntomas que podrían ser signos de cáncer de seno.

También mostrará a qué partes de la mamografía se dirige, revelando qué características específicas se parecen más a las lesiones cancerosas que ha visto antes en otros pacientes.

De esa manera, dice Rudin, su red está diseñada para imitar la forma en que los médicos hacen un diagnóstico.

“Es un razonamiento basado en casos”, dijo Rudin.

“Esperamos poder explicar mejor a los médicos o pacientes por qué su imagen fue clasificada por la red como maligna o benigna”.

Fuente: Noticias de la Ciencia