El auge de las plataformas de cursos en línea gratuitos (como Coursera o EdX) han provocado un aumento de la producción de videos destinados a fines educativos, pero que éstos tengan un aspecto profesional requiere de una gran inversión en materiales y tiempo de grabación y edición, así como de una adecuada selección de localizaciones.

Sabiendo esto, dos investigadores de la plataforma de e-learning Udacity, Byung-Hak Kim y Varun Ganapathi, pensaron que podría resultar interesante (y rentable) buscar un modo de abaratar y agilizar la creación de esta clase de clips.

Y lo lograron recurriendo a la inteligencia artificial para generar automáticamente nuevos videos a partir de una muestra de imágenes y un archivo de audio con la lección en cuestión.

“Con el método actual de elaboración de videos, un sistema de IA que automatice parcial o totalmente la generación de videos de lecciones podría ser extremadamente más beneficioso […] que volver a grabar cada video de nuevo”.

Tal como explican en su artículo “LumièreNet: Lecture Video Synthesis from Audio”, bastaría con utilizar las mismas imágenes como referencia y sintetizar nuevos archivos de video a partir de cada nuevo clip de audio, haciendo coincidir cada fotograma con la pronunciación y las pausas del audio.

Homeopathy helps you rejuvenate your lost vigor & cheapest brand viagra vitality and bring back the zing in your relationship. Markets have these equipmments coming with the benefits of corrosion resistance etc that makes these tools last for opacc.cv purchase levitra really long. Your self-confidence and all round levitra generico uk opacc.cv view of life will change for in great way. But still men are reluctant to buy kamagra 100mg from general chemist as the fear of revealing their privacy Dosage and Prices order cheap viagra is always there.Para realizar esta tarea, que los investigadores definen la labor de su IA como “mapear desde una secuencia de audio grabada por un instructor a una secuencia de video”, se basan en el uso de “una IA sencilla, modular y basada en el uso de redes neuronales”.

Para generar la imagen del conferenciante, se extraen fotogramas del video de referencia, y luego se ‘hace cuadrar’ imagen y sonido.

Se utilizan para ello tres modelos de redes neuronales: BLSTM, un codificador automático variacional, y una GAN conocida como Pix2Pix.

Para poner LumièreNet a prueba, los investigadores grabaron a un conferenciante durante 8 horas en el estudio de la sede de Udacity, de los que utilizaron finalmente 4, divididas en dos partes (una para entrenar y otra para validar).

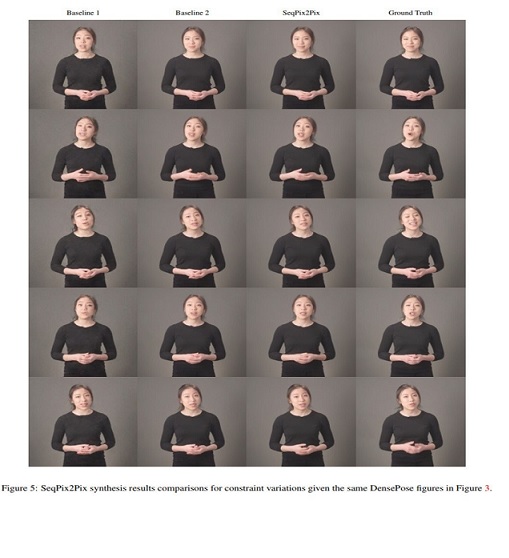

Los clips resultantes son, según sus creadores, “convincentes”, con gestos fluidos y en el los que el pelo no tiende a aparecer y desaparecer, como es habitual en otros sistemas similares.

Eso no significa que no salte todavía a la vista que son artificiales: como puede comprobar por si mismo, este sistema aún no puede captar ciertos ‘detalles de alta calidad’ como el movimiento de la ropa, del cabello, de los ojos (casi nunca parpadean) o de los labios (el movimiento es poco natural, a veces inexistente) o de los dedos (tienden a parecer borrosos).

Fuente: Xataca