ChatGPT se ha vuelto parte de la vida de millones de personas que lo utilizan a diario para diferentes tareas que van desde prepararse para entrevistas de trabajo hasta resumir reuniones.

Pero, ¿qué tan expuestas están sus conversaciones?

Desde hace tiempo sabemos que OpenAI puede utilizar el contenido de los chats para mejorar sus modelos de inteligencia artificial, a menos que se desactive el historial de chats o que se utilice la versión de pago ChatGPT Enterprise.

Lo anterior significa que algunos empleados de la compañía liderada por Sam Altman tienen la posibilidad de acceder a sus conversaciones con fines técnicos o de seguridad.

Por esto es tan importante no compartir información confidencial, y, sino que se lo digan a Samsung que acabó prohibiendo el uso de ChatGPT entre sus empleados.

Más allá de esto, hay otras maneras en las que las conversaciones pueden acabar en manos de un tercero, por ejemplo, de un ciberdelincuente.

Imagínese que está en un café utilizando ChatGPT desde su portátil conectado a la red Wifi pública.

Este escenario podría ser propicio para que un atacante pueda utilizar ciertos elementos que están a su alcance para intentar deducir las respuestas del chatbot. Todo esto, sin que ud. se de cuenta.

La información sobre el ataque proviene de un interesante estudio del Laboratorio de Investigación de IA Ofensiva de la Universidad Ben-Gurion en Israel que se desarrolla básicamente en cuatro pasos:

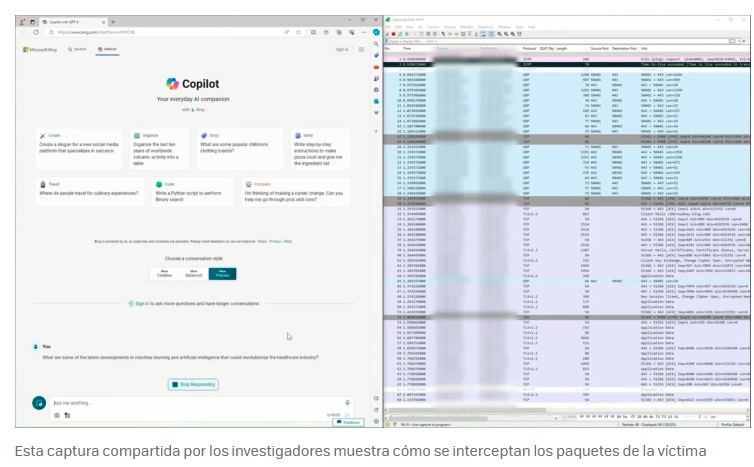

Interceptar el tráfico de la víctima

Filtrar los paquetes para hallar las respuestas de ChatGPT

Revelar la longitud de los tokens

Inferir la respuesta de ChatGPT utilizando un LLM

Si es usuario de ChatGPT, seguramente habrá notado que el chatbot va enviándole la respuesta progresivamente.

El modelo, GPT-3.5 o GPT-4, va transmitiendo los tokens con destino a su computador a medida que los va generando.

Ahora bien, aunque esta transmisión secuencial está cifrada, abre la puerta a utilizar un tipo de ataque conocido como Side-channel attack que puede revelar la longitud de lo tokens para inferir información.

El desafío que tiene el atacante en este punto es interceptar los datos enviados entre los servidores de OpenAI y su computador, algo que se puede conseguir con un ataque del tipo Man-in-the-Middle.

Una vez que el actor malintencionado ha comprometido la seguridad de la red, se encargará de filtrar el tráfico por dirección IP y de analizar los paquetes para detectar un patrón incremental con el fin de descubrir los paquetes relacionados a las respuestas de ChatGPT.

Después podrá identificar la longitud de lo tokens utilizando los tamaños de los paquetes observados anteriormente.

Aquí, precisamente, se presenta el nivel de mayor dificultad: dado que un token puede representar una unidad de texto tan breve como un carácter o tan larga como un conjunto de palabras, es necesario recurrir a una solución adicional para interpretarlos e inferir las respuestas.

La solución de los investigadores ha sido utilizar un LLM para esta tarea.

Estamos hablando de un modelo de lenguaje largo especialmente entrenado que es capaz de analizar la longitud de los tokens y predecir con bastante precisión las respuestas generadas por ChatGPT.

Los resultados pueden variar, pero en las pruebas el modelo fue capaz de inferir el 55% de todas las respuestas con una alta precisión (pueden cambiar ligeramente las palabras, pero poco el sentido de la frase). Además, el 29% de las mismas tenían una precisión perfecta.

Si bien se trata de un ataque que requiere de ciertos elementos sofisticados para su ejecución, nunca está de más tener presente hasta qué punto pueden acabar expuestos nuestros datos.

Cabe señalar que esta técnica, según los investigadores, no solo funciona con ChatGPT, sino también con otros bots de inteligencia artificial como Copilot que envían los tokens de manera secuencial.

Gemini de Google no es alcanzado, precisamente, porque tiene una arquitectura diferente.

Fuente: arsTechnica