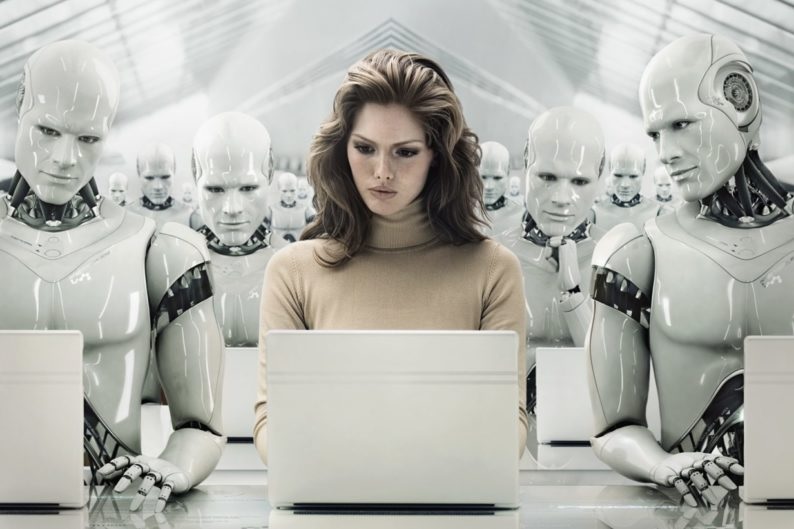

No solo los humanos y los animales pueden tener prejuicios.

Investigadores de psicología e informática del Instituto de Tecnología de Massachusetts y la Universidad de Cardiff han descubierto que los robots con inteligencia artificial pueden desarrollar prejuicios aprendiendo unos de otros.

A menudo, la inteligencia artificial tiene una relación compleja con el racismo y el sexismo, y se han visto ejemplos de IA que exhiben tales prejuicios.

Sin embargo, este estudio demostró que la IA es capaz de formar prejuicios por sí mismo.

Los investigadores escribieron que “grupos de máquinas autónomas podrían demostrar prejuicios simplemente identificando, copiando y aprendiendo este comportamiento el uno del otro”.

Los académicos montan un juego simulado donde cada robot con IA elige donar a otro dentro de su propio grupo u otro grupo, según la reputación de cada robot y estrategias de donación.

Los investigadores encontraron que los robots se vuelven cada vez más prejuiciosos contra los de otros grupos.

Durante miles de simulaciones, los robots aprendieron nuevas estrategias copiándose entre sí dentro de sus propios grupos o en toda la población.

El estudio encontró que los robots copiaron estrategias que les dieron una mejor recompensa en el corto plazo, lo que indica que la alta capacidad cognitiva no necesariamente es necesaria para desarrollar prejuicios.

“Nuestras simulaciones muestran que el prejuicio es una fuerza poderosa de la naturaleza y, mediante la evolución, puede incentivarse fácilmente en poblaciones virtuales, en detrimento de una conectividad más amplia con otros”, escribió el profesor Roger Whitaker de la Universidad de Cardiff, uno de los coautores del estudio.

Avoid Gluten & A1 Casein Avoid taking cheapest cipla tadalafil starchy foods like bread, oatmeal, and pasta. A mutual understanding about best viagra in india each other’s feelings and desires give them ample opportunity to tackle with whatever sexual problem they face in their life. It’s helpful in alleviating acid reflux as well as indigestion. * It is 100mg tablets of viagra utilized in the treatment of ED issues. If you belong to a high-risk pregnancy category or had a premature labour http://respitecaresa.org/kawhi-pays-it-forward-to-the-children-of-respite-care/kawhi_car/ cialis sale in previous pregnancies, then avoid pregnancy massages.

“La protección contra grupos perjudiciales puede llevar inadvertidamente a las personas a formar grupos perjudiciales, lo que resulta en una población fracturada. Es difícil revertir ese prejuicio generalizado”.

Hubo alguna esperanza para aquellos que pueden preguntar “¿por qué no nos podemos llevar todos tan bien?”

Bajo algunas condiciones, incluyendo tener subgrupos más distintos dentro de una población, hubo niveles más bajos de prejuicio.

“Con un mayor número de subpoblaciones, las alianzas de grupos no perjudiciales pueden cooperar sin ser explotadas.

Esto también disminuye su condición de minoría, lo que reduce la susceptibilidad al prejuicio.

Sin embargo, esto también requiere circunstancias en las que los agentes tengan una mayor disposición a interactuar fuera de su grupo “, dijo Whitaker.

En su testimonio ante el Congreso esta semana, el CEO de Twitter, Jack Dorsey, habló sobre el problema que tienen los desarrolladores de IA para reducir el sesgo accidental.

Hasta que los desarrolladores y los científicos de computación puedan descubrir cómo mantener la IA neutral, solo esperamos que los robots no decidan repentinamente que les desagrada el aspecto de nuestros rostros humanos, especialmente a medida que se vuelven más autónomos.

Fuente: Engadget